“Gravação circula com discurso adulterado; análise revela padrões típicos de inteligência artificial”

Por Julio Take/O Expresso BR

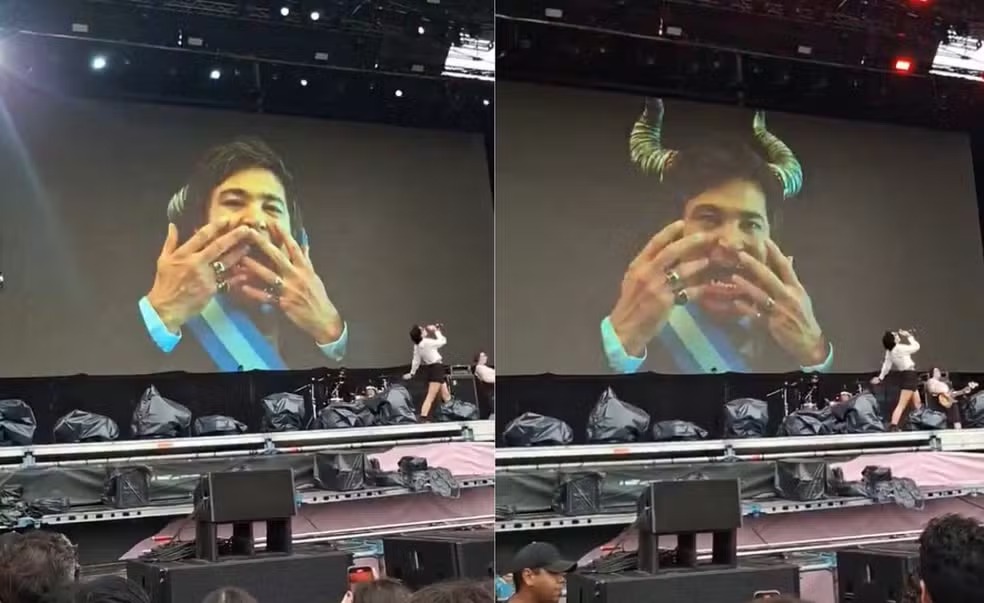

Um vídeo que supostamente mostra uma juíza dos Estados Unidos criticando o ministro do STF (Supremo Tribunal Federal) Alexandre de Moraes é falso. Especialistas em checagem de fatos e tecnologia identificaram indícios claros de manipulação por inteligência artificial (IA), como movimentos faciais repetitivos e sincronização irregular da fala.

A gravação, que circulou em redes sociais, apresenta uma mulher identificada como juíza norte-americana fazendo acusações infundadas contra Moraes. No entanto, uma análise mais detalhada revela falhas comuns em deepfakes — vídeos sintéticos gerados por IA. Entre os erros estão expressões faciais que se repetem em intervalos idênticos e falta de naturalidade nos gestos.

Como identificar um vídeo manipulado por IA?

Segundo investigações de veículos especializados em verificação de dados, como a Agência Lupa e o Projeto Comprova, alguns sinais de vídeos falsos incluem:

- Piscadas ou movimentos faciais repetitivos (a pessoa no vídeo repete o mesmo gesto várias vezes);

- Voz robótica ou dessincronizada (o áudio não combina perfeitamente com os movimentos labiais);

- Falta de imperfeições naturais (a pele parece muito lisa ou há distorções no cenário).

O caso reforça a preocupação com a disseminação de deepfakes na política. Nos últimos anos, vídeos falsos de autoridades mundiais, como o presidente dos EUA, Joe Biden, e o ucraniano Volodymyr Zelensky, já foram usados para espalhar desinformação.

Por que esse vídeo viralizou?

A suposta crítica ao ministro Alexandre de Moraes, alvo frequente de ataques de grupos políticos, pode ter impulsionado o compartilhamento. Especialistas alertam que conteúdos falsos tendem a se espalhar rapidamente quando reforçam narrativas polarizadas.

O que dizem as plataformas?

Redes como Facebook, X (antigo Twitter) e TikTok possuem políticas contra deepfakes, mas a remoção nem sempre é imediata. Usuários que identificarem vídeos suspeitos podem denunciá-los diretamente nas ferramentas das redes.

Conclusão

A desinformação digital é um desafio global, e vídeos manipulados por IA estão se tornando mais sofisticados. Antes de compartilhar, verifique a fonte e busque análises de veículos confiáveis.