Uma nova modalidade de estelionato digital está acendendo o alerta máximo nas autoridades de segurança cibernética em 2026. Utilizando ferramentas avançadas de Inteligência Artificial (IA), criminosos estão conseguindo replicar com precisão quase absoluta o timbre, a entonação e até os trejeitos de voz de vítimas para enganar seus familiares. O objetivo principal é a solicitação de transferências bancárias urgentes, geralmente via Pix.

O mecanismo do “Roubo da Voz”

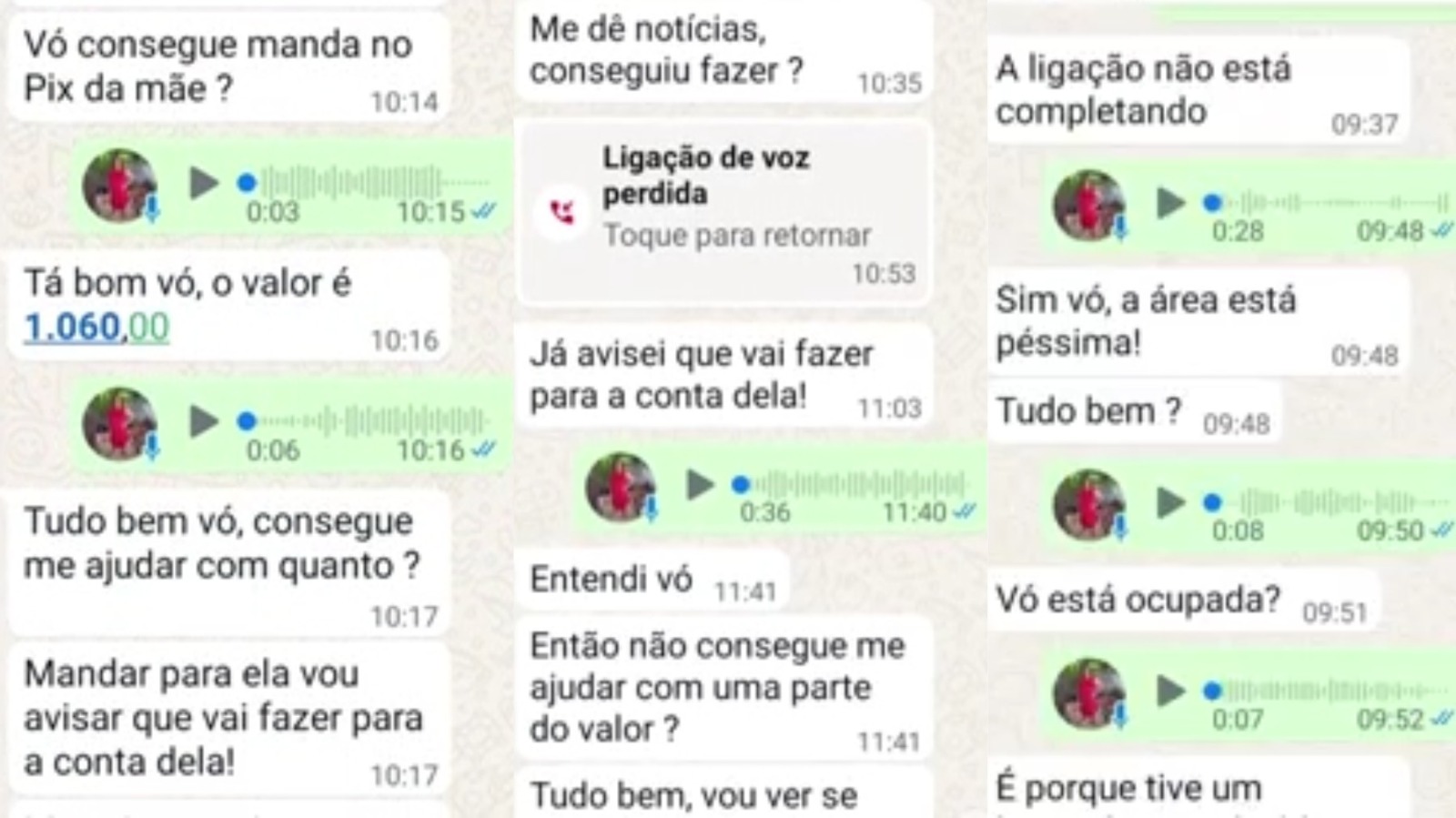

Diferente dos golpes tradicionais, onde o criminoso apenas fingia ser um parente por texto, a nova tática utiliza softwares de deepfake de áudio. Segundo investigações recentes da Polícia Civil, os golpistas obtêm amostras de voz de duas formas principais:

- Redes Sociais: Extração de áudios de vídeos postados em perfis públicos (Instagram, TikTok e YouTube).

- Ligações Fantasmas: Chamadas em que o criminoso permanece em silêncio apenas para gravar o “alô” e outras frases curtas da vítima, criando uma “assinatura vocal” sintética.

Com apenas 15 a 30 segundos de amostra, as IAs atuais conseguem gerar frases inteiras com a voz da pessoa, simulando situações de desespero, como acidentes ou sequestros falsos.

Casos recentes e sofisticação

Relatos colhidos neste início de ano mostram que os criminosos estão indo além do pedido de dinheiro. Em alguns casos registrados no interior de São Paulo, os golpistas utilizam informações contextuais — como nomes de netos ou profissões — para tornar a simulação ainda mais convincente.

”Eu ouvi minha filha chorando, pedindo ajuda porque o carro tinha quebrado e o celular novo não fazia ligação, apenas mandava áudio. Era a voz dela, o jeito dela de falar ‘mãe’. Não tive dúvidas e fiz o Pix”, relatou uma das vítimas que perdeu R$ 4.500 no golpe.

Como se proteger

Especialistas em segurança digital recomendam medidas práticas para evitar cair na fraude:

- Palavra-Chave Familiar: Estabeleça um código ou pergunta secreta que apenas os membros da família saibam. Se houver um pedido de dinheiro por voz, peça a palavra-chave.

- Desconfie de Urgência: Golpistas usam o fator emocional para impedir que a vítima pense racionalmente.

- Verificação Direta: Se receber um áudio suspeito, tente ligar imediatamente para o número original do familiar ou para outra pessoa que esteja com ele.

- Privacidade de Áudio: Evite manter perfis de redes sociais totalmente abertos se você costuma postar muitos vídeos falando.